Ответ нейросети нельзя оценивать только по тому, насколько он красиво написан. ИИ может звучать уверенно, давать стройную структуру, использовать убедительные формулировки и всё равно ошибаться в фактах, делать слабые выводы или предлагать решение, которое нельзя применить в реальной задаче. Поэтому проверка ответа должна идти не «нравится или не нравится», а по понятной схеме.

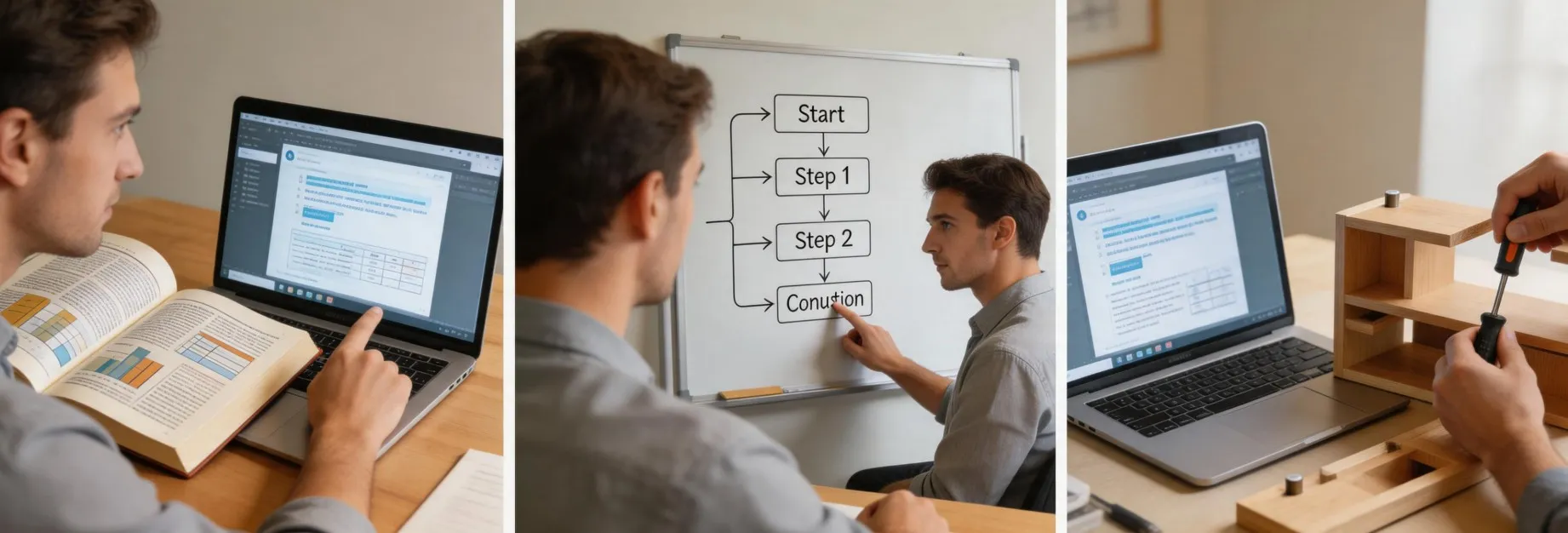

Самый удобный подход — проверять результат по трём уровням: факт, логика, применимость. Первый уровень отвечает на вопрос: правда ли это. Второй — правильно ли связаны причины, выводы и аргументы. Третий — можно ли использовать ответ в конкретной ситуации без лишнего риска. Такой порядок помогает быстро отличить полезный материал от текста, который выглядит убедительно только на первый взгляд.

Эта схема особенно нужна там, где ИИ используется для работы, обучения, документов, аналитики, инструкций, текстов, презентаций, бизнес-решений или подготовки материалов для других людей. NIST в описании доверенных ИИ-систем выделяет такие характеристики, как валидность, надёжность, прозрачность, объяснимость и безопасность, а UNESCO отдельно подчёркивает важность критического мышления и медиаграмотности в эпоху ИИ.

Первый уровень: проверка фактов

Факты — самая очевидная, но часто пропускаемая часть проверки. Пользователь видит аккуратный ответ и автоматически считает его верным. Проблема в том, что генеративный ИИ может ошибаться не грубо, а незаметно: перепутать дату, приписать цитату не тому человеку, придумать источник, неверно назвать функцию сервиса, смешать старую и новую информацию.

Фактическая проверка нужна каждый раз, когда в ответе есть конкретные утверждения: имена, даты, цифры, названия документов, ссылки на исследования, юридические нормы, медицинские советы, цены, характеристики продуктов, инструкции по настройке или данные о компаниях. Чем важнее решение, тем строже должна быть проверка.

Для быстрой оценки фактов полезно идти по конкретным пунктам:

- Найти все утверждения, которые можно проверить: даты, цифры, имена, названия, правила, характеристики.

- Сверить важные данные с первичным или официальным источником.

- Проверить, не устарела ли информация.

- Убедиться, что ИИ не подменил точный факт похожей формулировкой.

- Отделить факты от предположений, оценок и советов.

- Перепроверить всё, что связано с деньгами, здоровьем, законом, безопасностью и публичной публикацией.

После такой проверки ответ становится понятнее. Если факты подтверждаются, с ним можно работать дальше. Если в базовых данных есть ошибки, нет смысла оценивать стиль или красоту формулировок: сначала нужно исправить основу.

Второй уровень: проверка логики

Даже фактически верный ответ может быть слабым по логике. ИИ может правильно назвать отдельные данные, но неверно связать их между собой. Например, привести реальную статистику и сделать из неё слишком широкий вывод. Или перечислить причины, но не показать, какая из них главная. Или предложить решение, которое не следует из описанной проблемы.

Логическая проверка отвечает на вопрос: связаны ли части ответа между собой. Важно смотреть не только на итоговый вывод, но и на путь к нему. Хороший ответ объясняет, почему один факт важен, как он влияет на ситуацию и какие ограничения есть у вывода. Слабый ответ просто складывает убедительные фразы в один текст.

Типичные логические ошибки ИИ выглядят так: вывод шире, чем доказательства; причина и следствие перепутаны; важное исключение не учтено; разные ситуации смешаны в одну; совет звучит универсально, хотя подходит только для узкого случая. Такие ошибки опасны, потому что текст остаётся гладким и внешне профессиональным.

Особенно внимательно нужно проверять ответы, где ИИ сравнивает варианты, делает прогноз, предлагает стратегию, объясняет причину проблемы или советует, что выбрать. Здесь ошибка может быть не в факте, а в рассуждении.

Третий уровень: проверка применимости

Применимость — это ответ на вопрос: можно ли использовать результат именно в вашей ситуации. Нейросеть может дать правильный и логичный совет, который всё равно не подходит из-за контекста. Например, предложить хороший маркетинговый план без учёта бюджета, написать инструкцию не для той версии программы, составить текст не под ту аудиторию или дать решение, которое слишком сложно внедрить.

Этот уровень часто важнее первых двух. Ответ может быть фактически точным и логически стройным, но бесполезным на практике. Применимость проверяется через ограничения: кто будет использовать результат, где он будет опубликован, какие ресурсы есть, какой уровень подготовки у аудитории, какие риски допустимы, сколько времени есть на выполнение.

Для практических задач удобно сравнивать три уровня проверки в одной схеме.

| Уровень проверки | Главный вопрос | Что смотреть в ответе |

|---|---|---|

| Факт | Это правда? | Даты, цифры, имена, источники, правила, характеристики |

| Логика | Это правильно связано? | Причины, выводы, аргументы, исключения, последовательность |

| Применимость | Это можно использовать? | Контекст, аудитория, ресурсы, риски, формат, ограничения |

Такая схема помогает не спорить с ответом «на глаз». Если материал провалился на первом уровне, его нужно перепроверить. Если факты верны, но логика слабая, нужно перестроить выводы. Если всё верно, но не подходит под задачу, нужно адаптировать результат, а не использовать его как готовый.

Как проверять ответ ИИ на практике

Проверка не должна занимать больше времени, чем сама работа с ИИ. В большинстве случаев достаточно пройти по трём вопросам: что здесь является фактом, как из этого сделан вывод и можно ли применить это в моей ситуации. Если ответ нужен для внутренней заметки, проверка может быть короткой. Если материал пойдёт в статью, презентацию, коммерческое предложение, инструкцию или учебный материал, проверять нужно строже.

Удобный порядок такой: сначала выделить спорные места, затем проверить источники, после этого оценить рассуждение и только в конце редактировать стиль. Многие делают наоборот: исправляют формулировки, сокращают текст, добавляют заголовки, а потом обнаруживают, что внутри были ошибки. Это лишняя работа.

Для регулярного использования можно держать короткий чек-лист:

- Что в ответе является проверяемым фактом?

- Какие утверждения требуют источника?

- Нет ли устаревшей информации?

- Следует ли вывод из приведённых аргументов?

- Не пропущены ли важные ограничения?

- Подходит ли ответ под мою аудиторию и задачу?

- Что нужно изменить перед публикацией или применением?

Этот порядок хорошо работает для текстов, гайдов, сравнений, аналитики, учебных материалов и рабочих документов. Он не делает ИИ безошибочным, но снижает риск взять красивый, но неверный результат.

Какие ответы требуют самой строгой проверки

Не все ответы ИИ одинаково рискованны. Если нейросеть предлагает идеи для заголовков, план заметки или варианты формулировок, ошибка обычно легко исправляется. Если она даёт рекомендации по здоровью, праву, финансам, безопасности, программному коду или публичной информации о людях и компаниях, цена ошибки выше.

Строгая проверка особенно нужна для материалов, которые будут использовать другие люди. Внутренний черновик можно быстро исправить. Опубликованная статья, инструкция для клиентов, учебный материал или деловое письмо уже влияют на доверие. Чем шире аудитория, тем меньше права на непроверенные утверждения.

Отдельная зона риска — свежая информация. ИИ может не знать последних изменений или смешивать актуальные данные со старыми. Поэтому новости, цены, законы, функции сервисов, условия тарифов, релизы продуктов и статистику нужно проверять по свежим источникам. Это особенно важно для тем, где данные меняются быстро.

Как понять, что ответ выглядит подозрительно

Есть признаки, по которым слабый ответ можно заметить ещё до глубокой проверки. Самый явный — слишком уверенный тон без ссылок на источники. Если ИИ делает сильное утверждение, но не объясняет, откуда оно взято, его нужно проверять. Второй признак — общие фразы вместо конкретики. Третий — отсутствие ограничений: хороший ответ почти всегда показывает, где совет работает, а где нет.

Подозрительным также должен казаться ответ, который слишком легко соглашается с вопросом пользователя. Нейросети часто подстраиваются под формулировку запроса. Если спросить: «Почему этот подход лучший?», ИИ может начать доказывать, что он лучший, даже если есть серьёзные минусы. Поэтому сложные вопросы лучше задавать нейтрально: «Сравни плюсы и минусы», «Найди слабые места», «Проверь, где я могу ошибаться».

Полезный приём — просить ИИ отдельно найти ошибки в собственном ответе. Это не заменяет человеческую проверку, но помогает выявить слабые места. Например: «Проверь свой ответ по трём критериям: факты, логика, применимость. Укажи, что нужно перепроверить вручную». После этого результат часто становится честнее и практичнее.

Почему нельзя проверять ИИ только другим ИИ

Иногда кажется удобным: один ИИ написал, второй проверил. Такой подход может помочь на черновом этапе, но он не заменяет независимую проверку. Другая модель тоже может ошибиться, пропустить неточность или уверенно подтвердить слабый вывод. Особенно опасно использовать ИИ как единственный источник проверки фактов.

Нейросеть можно использовать как помощника: попросить найти спорные утверждения, составить список фактов для проверки, предложить контраргументы, указать возможные ограничения. Но окончательная проверка должна опираться на источники, экспертное знание и понимание задачи. В ответственных областях человек остаётся финальным фильтром.

NIST подчёркивает, что доверенность ИИ-систем связана не с одной характеристикой, а с балансом надёжности, прозрачности, безопасности, объяснимости и контекста применения. Это хорошо ложится на практическую проверку ответов: важна не только правильность текста, но и то, где, кем и для чего он используется.

Пример проверки одного ответа

Допустим, ИИ написал: «Компаниям стоит полностью заменить службу поддержки чат-ботом, потому что современные модели отвечают быстрее людей и почти не ошибаются». На первый взгляд мысль звучит уверенно, но при проверке быстро появляются проблемы.

На уровне фактов нужно проверить, правда ли современные модели «почти не ошибаются». Формулировка слишком сильная и требует доказательств. На уровне логики видно, что скорость ответа не доказывает возможность полной замены людей. Поддержка включает спорные случаи, эмоции клиента, нестандартные запросы, возвраты, жалобы и ответственность. На уровне применимости решение зависит от отрасли, риска, объёма обращений, типа клиентов и качества базы знаний.

После проверки такой ответ нужно переписать: ИИ может ускорить первую линию поддержки, помочь с типовыми вопросами и подготовить черновики ответов, но полная замена людей подходит не всем и требует контроля. Так из громкого, но слабого утверждения получается рабочий вывод.

Как превратить проверку в привычку

Проверка ответов ИИ должна быть не отдельным сложным этапом, а обычной частью работы. Лучше сразу относиться к нейросети как к сильному черновому помощнику, а не как к финальному автору. Тогда ошибки воспринимаются нормально: их не нужно бояться, их нужно находить до публикации или применения.

Хорошая рабочая привычка выглядит так: сначала запрос, потом черновой ответ, затем проверка по трём уровням, после этого уточнение и редактирование. Если ответ слабый, не нужно сразу переписывать всё вручную. Можно вернуть его в ИИ с конкретной задачей: «Исправь только фактические неточности», «Покажи, где выводы не следуют из аргументов», «Адаптируй под аудиторию новичков», «Убери советы, которые нельзя применять без специалиста».

Такой подход делает работу с ИИ более управляемой. Пользователь не просто принимает или отвергает ответ, а последовательно улучшает его.